优化方法基础知识:向量范数、矩阵范数、方向导数、梯度和海森矩阵

常见向量范数和矩阵范数

向量范数

1-范数:$||x||_1 = |x_1|+|x_2|+......+|x_n|$

2-范数:$||x||_2 = \sqrt{|x_1|+|x_2|+......+|x_n|}$

无穷-范数:$||x||_{\infty}=\max\limits_{1\leq{i}\leq{n}}\left\vert{x_i}\right\vert$

p-范数:$\|x\|_p=\left(\sum_{i=1}^n\lvert x_i\rvert^p\right)^{\frac{1}{p}}$ (1、2范数的一般形式)

矩阵范数

常见的矩阵范数:向量范数与矩阵范数具有相容性(见矩阵论)

由向量范数$\|\cdot\|_p$导出关于矩阵 $A_n\in R_n\times n$的$p$范数

$$

\|A\|_p=\max_{x\neq0}\frac{\|Ax\|_p}{\|x\|_p}=\max_{\|x\|_p=1}\|Ax\|_p

$$

其他还有:

$$

\begin{aligned} & \|A\|_1=\max_{1\leq j\leq n}\sum_{i=1}^{n}|a_{ij}| & & \text{(1-范数,列和范数)} & & \\ & \|A\|_{\infty}=\max_{1\leq i\leq n}\sum_{j=1}^{n}|a_{ij}| & & \text{(∞-范数,行和范数)} & & \\ & \|A\|_2=\sqrt{\rho(A^{T}A)} & & \text{(2-范数,谱范数)} & & \rho(A)=\max_{1\leq i\leq n}|\lambda_{i}|\end{aligned}

$$

方向导数、梯度和Hessian矩阵

1.方向导数

对于二元函数 $f(x,y)$来说,其方向导数为

$$

f_{\vec{l}}(x_0,y_0)=f_x(x_0,y_0)\cos\alpha+f_y(x_0,y_0)\cos\beta

$$

其中$\alpha,\beta$是$R^2$中向量$\vec{l}$的方向角.

简单的理解,就是沿着 $\vec{l}$ 方向的变化率。

2.梯度

也就是每个向量分别求偏导,组成的向量。

若$f(x,y,z)$在点$P_0(x_0,y_0,z_0)$存在对所有自变量的偏导数,则称向量$\left(f_x(P_0),f_y(P_0),f_z(P_0)\right)$为函数$f$在 点 $P_0$的梯度,记作

$$

grad\:f(P_{0})=\left(f_{x}(P_{0}),f_{y}(P_{0}),f_{z}(P_{0})\right).

$$

$gradf(P_{0})$的模为:${|grad\:f(P_0)|}={\sqrt{f_{x}(P_0)^2+f_{y}(P_0)^2+f_{z}(P_0)^2}}$

当函数在P0可微时,f在P0的 梯度方向 是f的值增长最快的方向,沿这一方向的 变化率 就是梯度的模!(也就是方向向量和梯度向量的夹角为0)当与梯度向量方向相反,方向导数有最小值。

$$

f_i(P_0)=gradf(P_0)\cdot\vec{l_0}=|gradf(P_0)|\cos\theta

$$

上式给出了方向导数的另外一种表示方法。就是该点梯度的模乘梯度向量grad $f(P_0)$和方向向量$\vec{l}_0$的夹角,也就是这里的$\theta$

3.海森矩阵(Hessian Matrix)

海森矩阵主要用于研究函数的曲率特性及其极值点的性质。

1. 定义

对于一个实值函数 $f: \mathbb{R}^n \to \mathbb{R}$,其海森矩阵是所有二阶偏导数的矩阵,定义为:

注:这里实际上就是按矩阵的元素标号求导。

$H(f) = \begin{bmatrix}\frac{\partial^2 f}{\partial x_1^2} & \frac{\partial^2 f}{\partial x_1 \partial x_2} & \dots & \frac{\partial^2 f}{\partial x_1 \partial x_n} \\\frac{\partial^2 f}{\partial x_2 \partial x_1} & \frac{\partial^2 f}{\partial x_2^2} & \dots & \frac{\partial^2 f}{\partial x_2 \partial x_n} \\\vdots & \vdots & \ddots & \vdots \\\frac{\partial^2 f}{\partial x_n \partial x_1} & \frac{\partial^2 f}{\partial x_n \partial x_2} & \dots & \frac{\partial^2 f}{\partial x_n^2}\end{bmatrix}.$

性质

- 海森矩阵是对称矩阵(连续时) (如果 $f$ 的二阶偏导数连续,即满足 Schwarz 条件)$\frac{\partial^2 f}{\partial x_i \partial x_j} = \frac{\partial^2 f}{\partial x_j \partial x_i}.$

- $H(f)$ 是 $f$ 的二阶导数的集合,用来描述函数的局部曲率。

2. 几何意义

-

海森矩阵描述了函数 $f$ 在某一点的曲率特性:

- 正定矩阵(Positive Definite): 函数在该点是局部极小值,函数值朝所有方向上升。

- 负定矩阵(Negative Definite): 函数在该点是局部极大值,函数值朝所有方向下降。

- 半正定或半负定矩阵: 函数可能存在[鞍点]()。

- 不定矩阵(Indefinite): 函数在该点是鞍点。

-

几何解释可以通过二次近似来理解:

在点 $x_0$ 附近,将 $f(x)$ 用二次泰勒展开近似:

$f(x) \approx f(x_0) + \nabla f(x_0)^\top (x - x_0) + \frac{1}{2}(x - x_0)^\top H(f)(x - x_0),$其中,二次项的符号由 $H(f)$ 决定。

3. 海森矩阵的特性

3.1 判断极值点

-

对于 $f(x)$ 的驻点(即 $\nabla f(x) = 0$),利用海森矩阵判断该点性质:

- 如果 $H(f)$ 正定,则该点是局部极小值;

- 如果 $H(f)$ 负定,则该点是局部极大值;

- 如果 $H(f)$ 不定,则该点是鞍点;

- 如果 $H(f)$ 半正定或半负定,需要进一步分析。

3.2 在牛顿法中的应用

在优化中,牛顿法利用海森矩阵来加速收敛:

- 更新公式:

$x^{k+1} = x^k - [H(f(x^k))]^{-1} \nabla f(x^k),$其中 $H(f(x^k))$ 是函数 $f(x)$ 在 $x^k$ 处的海森矩阵。 - 牛顿法通过二次近似快速找到局部极值点,但需要 $H(f)$ 可逆且正定。

4. 具体例子

示例 1:二维函数的海森矩阵

设 $f(x, y) = x^2 + xy + y^2$,计算其海森矩阵。

-

一阶偏导数:

$\frac{\partial f}{\partial x} = 2x + y, \quad \frac{\partial f}{\partial y} = 2y + x.$ -

二阶偏导数:

$\frac{\partial^2 f}{\partial x^2} = 2, \quad \frac{\partial^2 f}{\partial y^2} = 2, \quad \frac{\partial^2 f}{\partial x \partial y} = \frac{\partial^2 f}{\partial y \partial x} = 1.$ -

海森矩阵:

$H(f) = \begin{bmatrix}2 & 1 \\1 & 2\end{bmatrix}.$ -

判断矩阵性质:

- 特征值为 $3$ 和 $1$,均为正值,因此 $H(f)$ 正定,函数在驻点是局部极小值。

5.特殊求法

利用矩阵的微积分:

- 将 $f(x)$ 表示为矩阵运算形式。

- 使用矩阵微积分公式直接计算二阶导数。

示例:

若 $f(x) = \frac{1}{2}x^\top Q x + b^\top x + c$,其中 $Q$ 是对称矩阵:

-

海森矩阵为:

$$

H(f) = Q.

$$

二元函数求极值

Eg#1.函数 $f(x_1, x_2) = 2x_1^3 - 3x_1^2 - 6x_1x_2(x_1 - x_2 - 1)$。

1. 求稳定点(即驻点):

驻点的条件是对函数的偏导数分别对 $x_1$ 和 $x_2$ 求导,并满足偏导数为 0。

第一步:计算偏导数

对 $x_1$ 求偏导:

$$

\frac{\partial f}{\partial x_1} = \frac{\partial}{\partial x_1}\left(2x_1^3 - 3x_1^2 - 6x_1x_2(x_1 - x_2 - 1)\right)

$$

展开并逐项求导:

- $$

\frac{\partial}{\partial x_1}(2x_1^3) = 6x_1^2

$$ - $$

\frac{\partial}{\partial x_1}(-3x_1^2) = -6x_1

$$ - $$

\frac{\partial}{\partial x_1}(-6x_1x_2(x_1 - x_2 - 1)) = -6x_2(2x_1 - x_2 - 1)

$$

因此:

$\frac{\partial f}{\partial x_1} = 6x_1^2 - 6x_1 - 6x_2(2x_1 - x_2 - 1)$ 对 $x_2$ 求偏导:

$\frac{\partial f}{\partial x_2} = \frac{\partial}{\partial x_2}\left(2x_1^3 - 3x_1^2 - 6x_1x_2(x_1 - x_2 - 1)\right)$ 展开并逐项求导:

- $$

\frac{\partial}{\partial x_2}(2x_1^3) = 0

$$ - $$

\frac{\partial}{\partial x_2}(-3x_1^2) = 0

$$ - $$

\frac{\partial}{\partial x_2}(-6x_1x_2(x_1 - x_2 - 1)) = -6x_1(-x_1 + 2x_2 + 1)

$$

因此:

$\frac{\partial f}{\partial x_2} = 6x_1(x_1 - 2x_2 - 1)$

第二步:求解驻点

令 $\frac{\partial f}{\partial x_1} = 0$ 和 $\frac{\partial f}{\partial x_2} = 0$:

- $$

\frac{\partial f}{\partial x_1} = 6x_1^2 - 6x_1 - 6x_2(2x_1 - x_2 - 1) = 0

$$ - $$

\frac{\partial f}{\partial x_2} = 6x_1(x_1 - 2x_2 - 1) = 0

$$

从第 2 个方程:

$6x_1(x_1 - 2x_2 - 1) = 0$ 可得两种情况:

- $$

x_1 = 0

$$ - $x_1 - 2x_2 - 1 = 0$,即 $x_1 = 2x_2 + 1$

过程略。代入可解得:

所有驻点:

$(0, 0), \; (0, -1), \; (1, 0), \; (-1, -1)$

2. 判别稳定点的性质(极值判断):

使用 二阶导数判别法。记:

$f_{x_1x_1} = \frac{\partial^2 f}{\partial x_1^2}(A), \; f_{x_2x_2} = \frac{\partial^2 f}{\partial x_2^2}(B), \; f_{x_1x_2} = \frac{\partial^2 f}{\partial x_1 \partial x_2}(C)$

二阶偏导数:

- $$

f_{x_1x_1} = \frac{\partial}{\partial x_1}(6x_1^2 - 6x_1 - 6x_2(2x_1 - x_2 - 1)) = 12x_1 - 6 - 12x_2

$$ - $$

f_{x_2x_2} = \frac{\partial}{\partial x_2}(6x_1(x_1 - 2x_2 - 1)) = -12x_1

$$ - $$

f_{x_1x_2} = \frac{\partial}{\partial x_2}(-6x_2(2x_1 - x_2 - 1)) = -12x_1 + 6x_2 + 6

$$

记 Hessian 矩阵:

$H = \begin{bmatrix}f_{x_1x_1} & f_{x_1x_2} \\f_{x_1x_2} & f_{x_2x_2}\end{bmatrix}$ 计算每个驻点的 Hessian 确定性质。

也就是我们常说的:$\Delta=AC-B^2$ 判别(上面的行列式和数分课本的符号相反,记这里的。以下给出课本的情况,课本的**$\Delta=AC-B^2$ ,对于极小值的情况$A&\Delta$同号**)

如果$\Delta > 0$ 且 $A > 0$,极小值点(局部);

如果$\Delta > 0$ 且 $A < 0$,极大值点(局部);

如果$\Delta < 0$ ,不是极值点;

如果$\Delta = 0$,不能确定。

求最值和求极值的区别与联系?

二元函数的最值和极值有重要区别,虽然它们的计算方法有时相关,但最值问题通常需要额外的考虑。以下是详细区分:

1. 极值

-

定义:极值是指函数在某一点 $(x_1, x_2)$ 的局部范围内的最大值或最小值。具体来说:

- 局部极大值:在点 $(x_1, x_2)$ 的某个邻域内,$f(x_1, x_2)$ 大于等于邻域中所有其他点的函数值。

- 局部极小值:在点 $(x_1, x_2)$ 的某个邻域内,$f(x_1, x_2)$ 小于等于邻域中所有其他点的函数值。

-

求解方法:通过驻点和二阶导数判别法计算。这需要对函数在内部区域的驻点和其 Hessian 矩阵进行分析。

-

注意:极值只在函数的局部范围内定义,不考虑全局范围的最大或最小值。

2. 最值

-

定义:最值是指函数在整个定义域内的最大值和最小值。它包括:

- 全局最大值:函数在整个定义域内取到的最大值。

- 全局最小值:函数在整个定义域内取到的最小值。

-

求解方法:

-

找到函数内部的极值点(用驻点和 Hessian 矩阵判断)。

-

考虑函数在边界(或定义域边界)上的值:

- 若定义域是闭区域,函数的最值可能出现在边界上。

- 在边界上寻找极值通常需要参数化边界方程,转化为单变量问题。

-

比较所有可能点(包括内部极值点和边界上的值)以确定全局最值。

-

3. 极值与最值的关系

-

极值是最值的候选者之一,但极值并不一定是最值。例如:

- 函数可能有多个极值点,但它们的函数值可能不是定义域内的最大值或最小值。

- 最值可能出现在边界上,而极值通常只考虑内部驻点。

-

如果函数的定义域是整个平面(无边界),或者函数单调递增/递减,极值可能就是最值。

4. 是否用极值的方法计算最值?

不完全是。计算最值时,需要额外考虑函数的边界或特殊点。例如:

- 如果函数定义域是闭区域,例如矩形或圆形,最值可能出现在边界上。

- 如果函数定义域是开放区域(例如无约束的 $\mathbb{R}^2$),可以通过分析极值点及其函数值的极限来寻找最值。

因此,极值的计算方法(驻点 + Hessian)只能找到函数的局部极值点,但不能保证直接找到全局最值。

总结

- 极值是局部性质,通过驻点和 Hessian 矩阵分析得出。

- 最值是全局性质,需要考虑所有极值点及定义域边界上的值,甚至无穷远处的函数行为。

示例场景:

- $f(x_1, x_2) = x_1^2 + x_2^2$,在 $\mathbb{R}^2$ 上有唯一全局最小值 $(0, 0)$,无局部极大值。

- 如果定义域是闭圆 $x_1^2 + x_2^2 \leq 1$,最值出现在边界和内部极小值点上。

[鞍点]():在数学中,鞍点(Saddle Point) 是一个函数的驻点(即梯度为零的点),但它既不是局部极大值点也不是局部极小值点。鞍点的函数值在某些方向上是极大值,而在其他方向上是极小值,表现出类似马鞍形的特性。

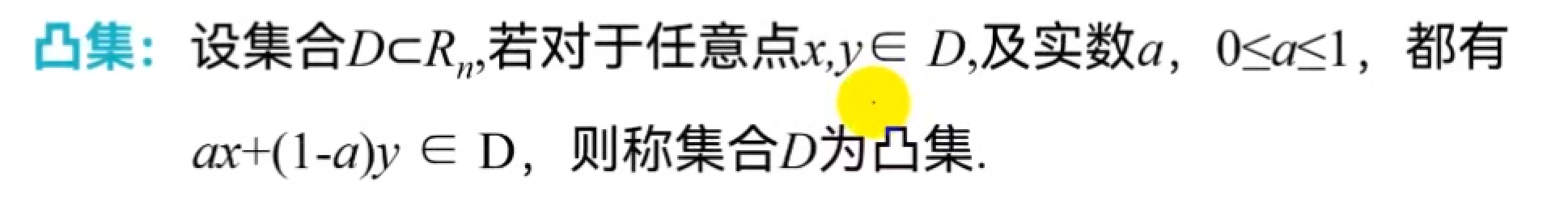

凸集和凸函数

凸集

n维向量空间$V$中,以向量$(\alpha_1,\alpha_2)$为端点的线段定义为

$\left\{r|r=k_1\alpha_1+k_2\alpha_2,k_1+k_2=1,k_1,k_2\geq0\right\}$

也就是:两个点在一个集合中,两个点连成一条直线,也在集合中,这个集合就叫凸集。

超平面$H=\{x|p^Tx=\alpha\}$是凸集,其中$p\in\mathbb{R}^n$是非零向量,称为超平面的法向量,α 为实数[(凸集分离定理)]()

闭半空间$H^-=\{x|p^Tx\leq\alpha\}$和$H^+=\{x|p^Tx\geq\alpha\}$是凸集;开半空间$H_o^-=\{x|p^Tx<\alpha\}$和$H_o^+=\{x|p^Tx>\alpha\}$是凸集

推论:##凸集的线性组合仍然是凸集##。

凸集的任意有限给点的凸组合仍然是凸集

可行集为凸集的凸规划问题可确保任意局部最优解也是问题的全局最优解

设 x∗ 是凸规划问题的一个局部最优解,则

(1) 局部最优解 x∗ 也是**全局最优解 .

(2) 如果目标函数是严格凸的,则 x∗ 是**唯一的全局最优解 .

严格分离、分离、投影定理在PPT46页,此处暂且略去。

Eg#2.要证明两个凸集的差集 $D_1 - D_2 = \{x - y \mid x \in D_1, y \in D_2\}$ 是凸集

1. 定义复习

凸集差的定义

给定两个集合 $D_1$ 和 $D_2$,它们的差定义为:

$D_1 - D_2 = \{z \mid z = x - y, \, x \in D_1, \, y \in D_2\}.$

2. 要证明的目标

我们需要证明 $D_1 - D_2$ 是凸集。即,任意 $z_1, z_2 \in D_1 - D_2$ 和 $\lambda \in [0, 1]$,满足:

$\lambda z_1 + (1 - \lambda) z_2 \in D_1 - D_2.$

3. 证明步骤

(a) 假设 $z_1, z_2 \in D_1 - D_2$

根据定义,存在 $x_1, x_2 \in D_1$ 和 $y_1, y_2 \in D_2$,使得:

$z_1 = x_1 - y_1, \quad z_2 = x_2 - y_2.$

(b) 构造 $\lambda z_1 + (1 - \lambda) z_2$

对任意 $\lambda \in [0, 1]$,我们有:

$\lambda z_1 + (1 - \lambda) z_2 = \lambda (x_1 - y_1) + (1 - \lambda) (x_2 - y_2).$将右侧展开:

$\lambda z_1 + (1 - \lambda) z_2 = (\lambda x_1 + (1 - \lambda) x_2) - (\lambda y_1 + (1 - \lambda) y_2).$

(c) 验证分量属于对应的凸集

- 由于 $x_1, x_2 \in D_1$,且 $D_1$ 是凸集,根据凸集定义:

$\lambda x_1 + (1 - \lambda) x_2 \in D_1.$

- 同理,因 $y_1, y_2 \in D_2$,且 $D_2$ 是凸集:

$\lambda y_1 + (1 - \lambda) y_2 \in D_2.$

(d) 得出结论

设 $x = \lambda x_1 + (1 - \lambda) x_2 \in D_1$,$y = \lambda y_1 + (1 - \lambda) y_2 \in D_2$,则:

$\lambda z_1 + (1 - \lambda) z_2 = x - y.$因此:

$\lambda z_1 + (1 - \lambda) z_2 \in D_1 - D_2.$由于 $z_1, z_2$ 和 $\lambda$ 是任意的,这表明 $D_1 - D_2$ 是凸集。

凸组合、凸函数

凸组合:$\sum_{i=1}^{k}\lambda_{i}=1,x=\sum_{i=1}^{k}\lambda_{i}x_{i}\text{ 称为}x_{1},x_{2},\cdots,x_{k}\text{的凸组合}.$

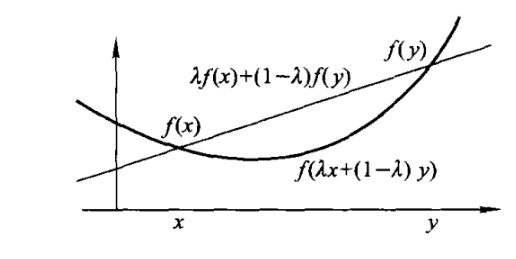

凸函数:设函数$f(x)$定义在凸集$D\subset R^n$上,若对任意的$x,y\in D$,及任意的$\alpha\in[0,1]$都有

$$

f(\alpha x+(1-\alpha)y)\leq\alpha f(x)+(1-\alpha)f(y)

$$

则称函数$f(x)$为凸集$D$上的凸函数。(下凸,和同济高数相反,典型例子是y=x^2)

几何上,代表这条曲线上方为凸集。任意连接这条曲线的两个点,直线总在曲线上方。

凸函数的判定定理

设$f(x)$定义在凸集$D\subset R^n$上,$x,y\in D$.令$\Phi(t)=f(tx+(1-t)y),t\in[0,1]$,则:

- $f(x)$是凸集$D$上的凸函数的充要条件是对任意的$x\in D$,一元函数 $\Phi(t)$为[0,1]上的凸函数.

- $f(x)$是凸集$D$上的严格凸函数的充要条件是对任意$x,y\in D(x\neq y)$,一元函数$\Phi(t)$为[0,1]上的严格凸函数。

严格凸函数也就是所谓的不取等号。

可行域与约束

几个概念:

可行域:满足所有限制条件的所有点组成的集合

可行点:满足所有限制条件的点

有效约束(active constraint) :边界点(满足某不等式约束)。称该不等式在该点是active constraint。

在一个可行点$\bar{x}$考虑不等式约束 $c_i(x)\geq0$ 如果有 $c_i(\bar{x})=0$,就称不等式约束$c_i(x)\geq0$在点 $\bar{x}$ 是有效约束或起作用约束 (active constraint),并称可行点$\bar{x}$位于约束 $c_i(x)\geq0$ 的边界。

我们用$I(\bar{x})$表示在$\bar{x}$处所有有效的不等式约束的指标集(就是这个点在哪些边界上,这些边界的下标集合,同时不包含等式)

$$

I(\bar{x})=\{i|c_i(\bar{x})=0,i\in I\}

$$

无效约束(inactive constraint):就是$\bar{x}$是不在边界上的可行点,则这个不等式在$\bar{x}$处是无效约束。$\bar{x}$又叫这个约束不等式的内点。

(注意,此处是定义在单个约束不等式上的。下面给出在可行域上的定义)

在任意可行点,所有的等式约束都被认为是有效约束, 在一个可行点,所有有效约束的全体被称为该可行点的有效集,其指标集记为

$$

A_{\overline{x}}=\{i|i=1,2,\cdots,m,m+1,\cdots,p|c_i(\overline{x})=0\}

$$

$$

A_{\overline{x}}=E\cup I(\bar{x})\quad

$$

对于一可行点$\bar{x}$ 如果没有一个不等式约束是有效的,就称$\bar{x}$是可行域的内点,不是内点的可行点就是可行域的边界点.显然,在边界点至少有一个不等式约束是有效约束.当存在等式约束时,任何可行点都要满足等式约束,因此不可能是等式约束的内点.

凸函数的条件

凸函数的一阶和二阶条件

凸函数在优化和数学分析中具有重要意义。通过函数的导数信息,可以判断其是否为凸函数。以下分别从一阶条件和二阶条件解释凸函数的判定方法:

1. 一阶条件

定义

一个可微函数 $f(x): \mathbb{R}^n \to \mathbb{R}$ 是凸函数,当且仅当它满足以下不等式:

$f(y) \geq f(x) + \nabla f(x)^\top (y - x), \quad \forall x, y \in \mathbb{R}^n.$

几何意义

- 割线在切线上方

适用范围

- 一阶条件适用于一次可微的函数。

2. 二阶条件

定义

如果函数 $f(x): \mathbb{R}^n \to \mathbb{R}$ 是二次可微的,则 $f(x)$ 是凸函数,当且仅当它在定义域内的海森矩阵(Hessian Matrix) $H(f(x))$ 是半正定的:

$H(f(x)) \succeq 0, \quad \forall x \in \text{定义域}.$

- 半正定的矩阵满足:$v^\top H(f(x)) v \geq 0, \quad \forall v \in \mathbb{R}^n.$

几何意义

- 海森矩阵的半正定性意味着函数的二阶导数在任何方向上都不小于零,表明曲率非负,即函数的图形在每一点都是“向上的”。

适用范围

- 二阶条件适用于二次可微的函数。

3. 特殊情况

严格凸函数

- 一阶条件:

如果 $f(x)$ 是严格凸函数,则不等式改为严格大于:

$f(y) > f(x) + \nabla f(x)^\top (y - x), \quad \forall x \neq y.$ - 二阶条件:

严格凸函数的海森矩阵 $H(f(x))$ 必须是正定的:

$H(f(x)) \succ 0, \quad \forall x \in \text{定义域}.$

4. 一阶与二阶条件的关系

- 一阶条件是凸性的必要条件,对于不可微函数可能是唯一适用的。

- 二阶条件是更强的判定条件,但需要函数具有二阶导数。

5. 示例

示例 1:单变量函数的凸性判定

设 $f(x) = x^2$,判断其是否为凸函数。

-

一阶条件:

$f(y) = y^2, \quad f(x) = x^2, \quad \nabla f(x) = 2x.$验证 $f(y) \geq f(x) + \nabla f(x) (y - x)$:$y^2 \geq x^2 + 2x(y - x) \quad \text{(成立)}.$

-

二阶条件:$f''(x) = 2>0, \text{即海森矩阵为正定,函数为凸函数。}$

示例 2:多变量函数的凸性判定

设 $f(x, y) = x^2 + y^2$,判断其是否为凸函数。

- 一阶条件:

梯度为 $\nabla f(x, y) = [2x, 2y]^\top$,验证 $f(y) \geq f(x) + \nabla f(x)^\top (y - x)$,成立。 - 二阶条件:

海森矩阵为:

$H(f) = \begin{bmatrix}2 & 0 \\0 & 2\end{bmatrix}.$其特征值均为正,矩阵正定,函数为凸函数

*正定与半正定

概念

- 正定矩阵(Positive Definite Matrix)

对称矩阵 $A \in \mathbb{R}^{n \times n}$ 是正定的,当且仅当对于任意非零向量 $x \in \mathbb{R}^n$,满足:

$x^\top A x > 0.$ - 半正定矩阵(Positive Semi-Definite Matrix)

对称矩阵 $A \in \mathbb{R}^{n \times n}$ 是半正定的,当且仅当对于任意向量 $x \in \mathbb{R}^n$,满足:

$x^\top A x \geq 0.$

判定方法

1. 特征值判定

- 正定: 所有特征值均为正。

- 半正定: 所有特征值均非负。

2. 主子式判定(仅对对称矩阵适用)

- 正定: 所有主子式(即从左上角开始的所有子矩阵的行列式)均为正。

- 半正定: 所有主子式均非负。

3. 对角线元素判定(充分但非必要)

- 正定: 所有对角线元素为正(且其他条件需满足)。

- 半正定: 所有对角线元素非负(且其他条件需满足)。

几何意义

- 正定矩阵: 曲率总是向上(严格上凸)。

- 半正定矩阵: 曲率向上或平坦(可能部分方向平坦)。